Digitale Sensoren

- Details

- Geschrieben von Thomas

- Kategorie: Kapitel Drei

- Veröffentlicht: 16. Dezember 2011

- Zugriffe: 11719

Im Gegensatz zur Bildentstehung durch chemische Prozesse wird auf einen Sensor elektrisch „belichtet“. Derzeit gibt es drei verschiedene Typen. Eine Änderung scheint da auch in nächster Zeit nicht in Sicht zu sein. Es gibt den CCD (Charge Coupled Device), den APS (Active Pixel Sensor) der nach seiner Fertigungstechnik auch oft als CMOS-Sensor (Complementary Metal Oxid Semiconductor) bezeichnet, diese Bezeichnung werde ich ebenfalls verwenden wird und den X3-CMOS-Sensor von Foveon.

Der Siegeszug der Digitalkameras wird derzeit immer noch durch den recht hohen Preis (für ordentliche Qualität) gebremst, ist aber sicherlich nicht mehr aufzuhalten. In diesem Handbuch schreibe ich über „Kameras“ und nicht über irgendwelche Mobilfotofone, Mini-Kompakt...Knipsen. Diese Arroganz leiste ich mir hierJ, auch wenn sehr viele immer noch begeistert davon sind, was diese kleinen Geräte für tolle Fotos (bekanntlich ist alles Geschmackssache und über den kann man nicht streiten, sollte man auch nicht, bringt auch nichts!) machen.

Der Preis des Aufnahmesensor macht meist rund 40% der Produktionskosten des Kameragehäuses aus.

Der CCD-Sensor

wurde bereits 1969 von Georg Smith und Willard Boyle (die dafür 2009 den Nobelpreis für Physik erhielten) entwickelt und sollte ursprünglich eigentlich der Datenspeicherung dienen. Als man feststellte, dass das entstandene Bauteil lichtempfindlich war, wurde er speziell für Foto- und Videoanwendungen weiterentwickelt und ist in Sachen Bildqualität zurzeit unerreicht. Leider ist er durch die, für seine Produktion notwendigen, speziellen, hochwertigen Fertigungsanlagen und den hohen Anteil an Ausschuss in der Produktion sehr teuer.

wurde bereits 1969 von Georg Smith und Willard Boyle (die dafür 2009 den Nobelpreis für Physik erhielten) entwickelt und sollte ursprünglich eigentlich der Datenspeicherung dienen. Als man feststellte, dass das entstandene Bauteil lichtempfindlich war, wurde er speziell für Foto- und Videoanwendungen weiterentwickelt und ist in Sachen Bildqualität zurzeit unerreicht. Leider ist er durch die, für seine Produktion notwendigen, speziellen, hochwertigen Fertigungsanlagen und den hohen Anteil an Ausschuss in der Produktion sehr teuer.

Ein CCD arbeitet mit analogen Signalen, die in der Kamera zentral durch einen Analog/Digital-Wandler (A/D-Wandler) digitalisiert werden. Der Vorteil der CCD- Sensoren ist die sehr geringe Neigung zu Bildrauschen und die daraus resultierende hohe Bildqualität.

Beim CMOS-Sensor befindet sich in jedem Pixel ein RAM-Speicher und ein A/D-Wandler. Dadurch kann ein Teil der Signalumwandlung direkt im Pixel erfolgen, was eine deutlich höhere Auslesegeschwindigkeit und einen geringeren Stromverbrauch bewirkt. Allerdings verringern diese nicht lichtempfindlichen Bauteile, die lichtempfindliche Sensorfläche um etwa 50%, was zu einer erhöhten Rauschneigung des CMOS-Sensors gegenüber dem CCD-Sensor führt.

Beim CMOS-Sensor befindet sich in jedem Pixel ein RAM-Speicher und ein A/D-Wandler. Dadurch kann ein Teil der Signalumwandlung direkt im Pixel erfolgen, was eine deutlich höhere Auslesegeschwindigkeit und einen geringeren Stromverbrauch bewirkt. Allerdings verringern diese nicht lichtempfindlichen Bauteile, die lichtempfindliche Sensorfläche um etwa 50%, was zu einer erhöhten Rauschneigung des CMOS-Sensors gegenüber dem CCD-Sensor führt.

Im Gegensatz zum CCD- Sensor, dessen Pixel nur zeilen- und spaltenweise ausgelesen werden können, kann bei einem CMOS-Sensor jedes Pixel einzeln ausgelesen werden.

Allerdings sind CMOS-Sensoren durch die langen Signalleitungen zur Ansteuerung der einzelnen Pixel und die schon beschriebene verringerte „Aufnahmefläche“ anfällig gegen Rauschen, welches mit steigender Pixelzahl noch zunimmt!

Von der Bildqualität insgesamt sind die beiden angesprochenen Sensoren mittlerweile etwa gleich gut, jedoch hat jeder spezifische Stärken und Schwächen.

Vorteile/ Nachteile CCD

-

-

geringes Rauschen

-

hoher Stromverbrauch

-

Vorteile/ Nachteile CMOS

-

geringer Stromverbrauch, etwa 10% des CCD, die Versorgungsspannung liegt bei 3 – 5 Volt, die eines CCD bei 12V.

-

Starkes Rauschverhalten erfordert Rauschkorrektur.

Während der CMOS früher eher in Kameras der Billig-Klasse eingesetzt wurde, verdrängt er den CCD mittlerweile bei den DSLR-Kameras, da hier seine Vorteile gegenüber dem CCD offenbar überwiegen. In den Kompakt- und Bridge-Kameras dominiert derzeit der CCD-Sensor den Markt.

Auf den X3-CMOS möchte ich gleich eingehen, nachdem wir die Farbdarstellung der CCD- und CMOS-Sensoren betrachtet haben.

Farbdarstellung

Alle drei Sensoren (an sich) sind farbenblind! Farben registrieren sie nur durch Farbfilterfolien vor den einzelnen Sensorelementen (Pixeln). Dabei verwenden der CCD und der CMOS die gleiche Technik an. Und die dabei angewendete Vorgehensweise schauen wir uns im folgenden einmal an.

CCD und CMOS

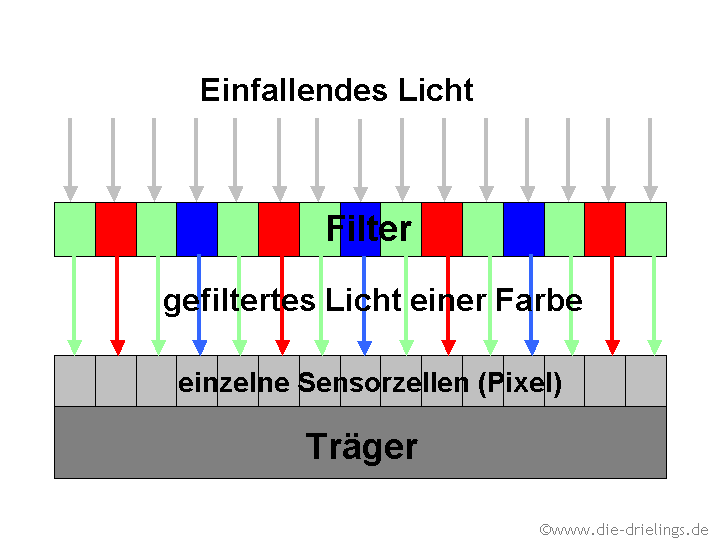

Vor jeder einzelnen Sensorzelle ist eine Farbfilterfolie angebracht, die nur ihre eigene Farbe durchlässt. Die verwendeten Filter sind rot, grün und blau (additive Farbmischung / RGB-Farbschema). Das Prinzip nennt sich Bayer-Matrix, Bayer-Filter oder Bayer-Pattern (nach ihrem Erfinder Bryce E. Bayer). Im Namen der Eastman Kodak Company reichte er am 5. März 1975 das Patent hierzu den USA ein. benannt.

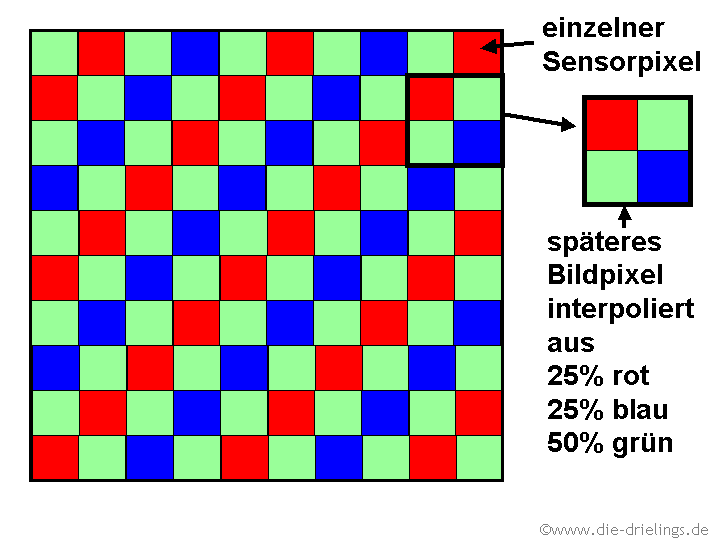

Aufgrund dieser Filter trifft auf jeden Sensorpixel nur eine einzelne (vom Filter abhängige) Farbe.Die Farbe jedes einzelnen der Bildpunktes im späteren Bild , wird aus den „Werte“ mehrere nebeneinander liegender Sensorzellen interpoliert (errechnet). Da das menschliche Auge im grünen Farbbereich deutlich empfindlicher ist, verwenden die meisten Hersteller doppelt so viele grüne Filter als rote und blaue. Wie viele Sensorpixel zu einem Bildpixel zusammengerechnet werden hängt vom Hersteller des Chips und von der ISO-Einstellung der Kamera ab.

Da aufgrund dieser „Zusammenfassung“ mehrerer Sensorpixel zu einem Bildpixel die Anzahl an Bildpunkten stark sinken würde, werden die einzelnen Bildpunkte mehrfach zur Errechnung von Bildpixeln benutzt. Das heißt mal mit den Pixeln „darüber“, mal mit denen darunter, mal mit denen rechts, mal links, so dass hier wieder auf eine höhere Megapixelzahl erreicht wird. Neben den „blinden“ Lücken zwischen den einzelnen Farbpixeln, begründet das Interpolieren der Farbwerte aus mehreren Pixeln einen Nachteil dieser Technik in der Farbwiedergabe. Besonders entlang von Kanten, vor allem wenn hier hohe Helligkeits- oder Farbkontraste vorliegen, entstehen falsche Farbinformationen. Die Hersteller versuchen dieses durch die unterschiedlichsten Rechenwege zu minimieren.

Die letztendliche Ausgabe der Farbwerte ist, wie wir sehen, nicht vom Sensor sondern von der Kamera-Software abhängig, so das es vorkommen kann, dass verschiedene Kameramodelle unterschiedliche Bilder erzeugen, obwohl sie denselben Chip verwenden.

Dieses führt dazu, das ein Fotograf eine Kamera total toll findet, weil ihn das Farbergebnis anspricht, eine andere aber ablehnt, obwohl beide Kameras den gleichen Sensorchip (aber eine andere Software) verwenden. Schon eine Veränderung der Firmware der Kamera kann Veränderungen in der Farbwiedergabe hervorrufen.

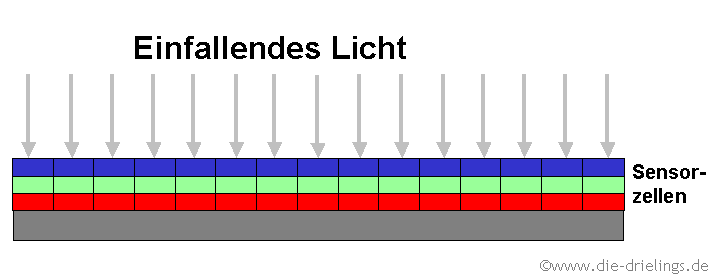

Der X3-CMOS

Im Gegensatz zu den beiden bisher behandelten Sensoren arbeitet der X3-CMOS nicht mit einer Bayer-Matrix. Bei diesen Sensoren werden drei unterschiedlich farbempfindliche Schichten in einer Sensorzelle übereinander angebracht, so dass einfallendes Licht je nach Farbe unterschiedlich tief eindringt. Aus der Eindringtiefe wird die Farbe „direkt“ für jeden Pixel ermittelt, sie muss nicht aus anderen Pixeln interpoliert werden! Allerdings besteht auch hier das Problem der verringerten lichtempfindlichen Oberfläche aufgrund der zusätzlich enthaltenen Bauteile, wie Speicher und A/D-Wandler. Die Auflösung ist deshalb geringer als bei CCD-Sensoren.

Im Gegensatz zu den beiden bisher behandelten Sensoren arbeitet der X3-CMOS nicht mit einer Bayer-Matrix. Bei diesen Sensoren werden drei unterschiedlich farbempfindliche Schichten in einer Sensorzelle übereinander angebracht, so dass einfallendes Licht je nach Farbe unterschiedlich tief eindringt. Aus der Eindringtiefe wird die Farbe „direkt“ für jeden Pixel ermittelt, sie muss nicht aus anderen Pixeln interpoliert werden! Allerdings besteht auch hier das Problem der verringerten lichtempfindlichen Oberfläche aufgrund der zusätzlich enthaltenen Bauteile, wie Speicher und A/D-Wandler. Die Auflösung ist deshalb geringer als bei CCD-Sensoren.

Wie beim bisher beschriebenen CMOS kann jedes Pixel einzeln angesteuert werden und liefert jedes für sich die kompletten Farbinformationen. Farbsäume an Kanten und Artefakte gibt es hier nicht. Mit X3-CMOS-Sensoren lassen sich, gerade für messtechnische Anwendungen, hochwertige Farbbilder erstellen. Allerdings zeigen X3-CMOS-Sensoren spezifisches Farbrauschen und Farbverschiebungen, welche ihn für die „normale“ fotografische Anwendung wenig geeignet erscheinen lassen. Ein ganz großes Problem ist die geringe Eignung für Langzeitbeichtungen, weil mit zunehmender Aufnahmedauer diese Farbverschiebungen und das Rauschen stark zunehmen.

Die Firma Sigma verwendete in mehreren digitalen Spiegelreflexkameras und auch Kompaktkameras diesen Sensortyp. Bei diesen Kameras liegt die maximale Belichtungszeit bei 2 Minuten. Bisher konnte sich dieser Sensor in der „normalen“ Fotografie, so wie wir es betreiben, nicht durchsetzen.

Hier geht es vorläufig erst einmal mit Kapitel Vier weiter, welches mit der Brennweite beginnt.