Bildfehler

- Details

- Geschrieben von Thomas

- Kategorie: Kapitel Fünf

- Zugriffe: 5416

Alle Objektive weisen Mängel auf, selbst die Hersteller bestreiten dieses nicht. Gelegentlich kann es jedoch recht nützlich sein, über diese Mängel etwas mehr zu wissen.

Grundsätzlich gilt: Mit einem Qualitätsobjektiv (ganz bestimmt mit einer ordentlichen Festbrennweite) kann jeder gute Bilder machen, der die notwendigen Fertigkeiten und Kenntnisse besitzt und richtig anwendet!

Ein Problem unserer Zeit ist, dass anscheinend viele ihr „Wissen“ aus einer der mittlerweile zahlreichen Zeitschriften gewinnen, bei denen man nicht weiß, wer hinter den Tests steht und wo das Geld für die Tests herkommt. Es wird viel über Schärfe, Brillanz und Kontrast gesprochen wird, ohne dass eindeutig vorher geklärt wurde worüber der Sprecher /Schreiber redet! Bei den entstehenden Diskussionen werden dafür aber andere Mängel, welche fotografisch deutlicher wirken vernachlässigt.

Ein Problem unserer Zeit ist, dass anscheinend viele ihr „Wissen“ aus einer der mittlerweile zahlreichen Zeitschriften gewinnen, bei denen man nicht weiß, wer hinter den Tests steht und wo das Geld für die Tests herkommt. Es wird viel über Schärfe, Brillanz und Kontrast gesprochen wird, ohne dass eindeutig vorher geklärt wurde worüber der Sprecher /Schreiber redet! Bei den entstehenden Diskussionen werden dafür aber andere Mängel, welche fotografisch deutlicher wirken vernachlässigt.

Dazu ein kleines Gedankenexperiment: In einer Fotozeitschrift werden vier vergleichbare Objektive getestet, welches kaufst Du Dir? Den Testsieger oder das, welches an das Bajonett Deiner Kamera passt?

Sphärische Aberration

- Details

- Geschrieben von Thomas

- Kategorie: Kapitel Fünf

- Zugriffe: 7809

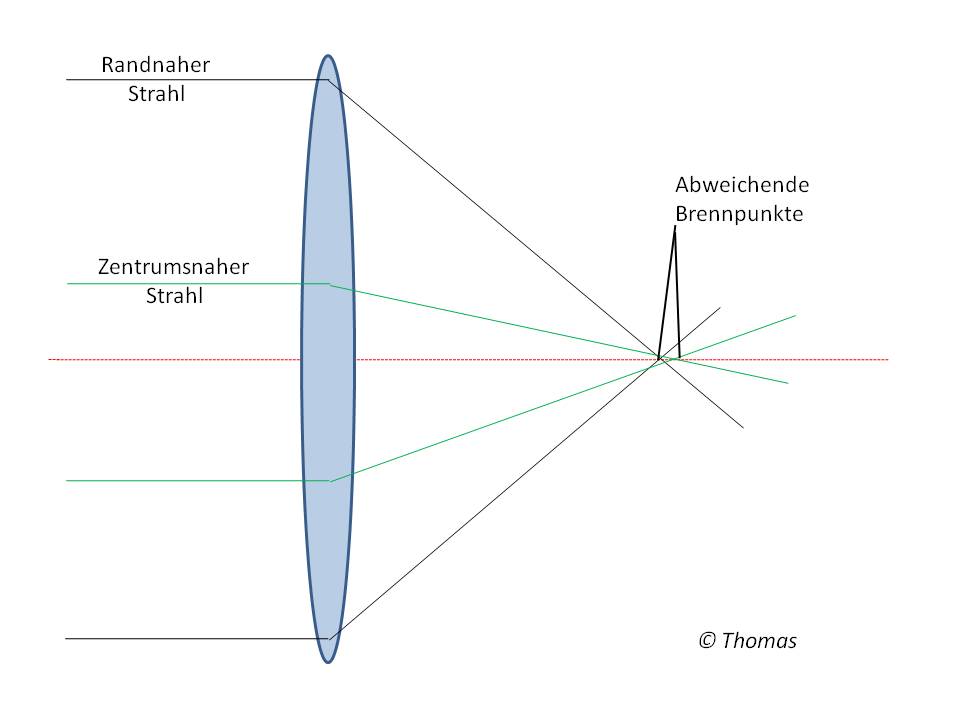

Sphärische Aberration (Öffnungsfehler)  bezeichnet die Tatsache, dass Linsen mit kugelförmiger Oberfläche, Lichtstrahlen, welche durch ihren Randbereich gehen, nicht genau in den (theoretischen) Brennpunkt der Linse lenken können. Dieser Fehler wird jedoch nur durch Lichtstrahlen verursacht, welche Nahe am Rand der Linse eintreffen, deshalb kannst Du ihn durch Abblenden auf mittlere Blendewerte reduzieren. Vollständiges Abblenden sollte, da hier nur noch Lichtstrahlen das Zentrum des Linse passieren können, den Fehler vollständig beseitgen. Allerdings treten hier an den Blendenkannten Beugungseffekte auf, die die Bildqualität wieder verschlechtern.

bezeichnet die Tatsache, dass Linsen mit kugelförmiger Oberfläche, Lichtstrahlen, welche durch ihren Randbereich gehen, nicht genau in den (theoretischen) Brennpunkt der Linse lenken können. Dieser Fehler wird jedoch nur durch Lichtstrahlen verursacht, welche Nahe am Rand der Linse eintreffen, deshalb kannst Du ihn durch Abblenden auf mittlere Blendewerte reduzieren. Vollständiges Abblenden sollte, da hier nur noch Lichtstrahlen das Zentrum des Linse passieren können, den Fehler vollständig beseitgen. Allerdings treten hier an den Blendenkannten Beugungseffekte auf, die die Bildqualität wieder verschlechtern.

'Weichzeichnerobjektive' nutzen die Sphärische Aberration für ihre bekannte Bildwirkung, hier ist die Sphärische Aberration nur wenig, man sagt auch unterkorrigiert.

Dieses Beispiel zeigt allerdings eines ganz deutlich: ein Abbildungsfehler kann auch geeignet sein, einer Aufnahme etwas mehr Stimmung zu verleihen.

Weiter geht es mit der chromatischen Aberration.

Chromatische Aberration

- Details

- Geschrieben von Thomas

- Kategorie: Kapitel Fünf

- Zugriffe: 6987

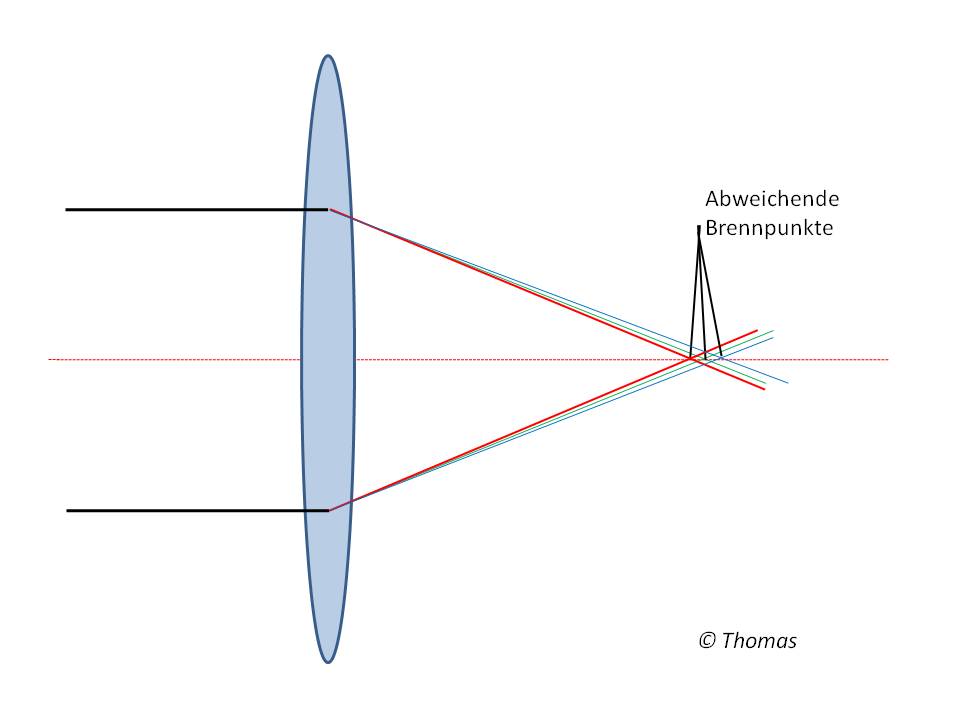

Chromatische Aberration (Farblängsfehler)  entsteht, wenn eine Linse durchgehendes Licht in seine Bestandteile zerlegt (Regenbogenfarben). Lichtstrahlen, welche durch den Linsenrand gehen, jtreffen dann, je nach Farbe, etwas vor oder hinter dem Brennpunkt der Linse auf die optische Achse. Dabei entstehen dünne Farbsäume an Konturen (meist gut bei billigen Ferngläsern, oder Lupen zu sehen). Auch die chromatische Aberration lässt sich durch Abblenden vermindern, da auch hier die Übertäter jene Lichtstrahlen sind, welche die Linse am Rand passieren. Vor allem lichtstarke Objektive sind von den beiden Formen der Aberration betroffen. Spiegelobjektive zeigen diese Fehler nicht.

entsteht, wenn eine Linse durchgehendes Licht in seine Bestandteile zerlegt (Regenbogenfarben). Lichtstrahlen, welche durch den Linsenrand gehen, jtreffen dann, je nach Farbe, etwas vor oder hinter dem Brennpunkt der Linse auf die optische Achse. Dabei entstehen dünne Farbsäume an Konturen (meist gut bei billigen Ferngläsern, oder Lupen zu sehen). Auch die chromatische Aberration lässt sich durch Abblenden vermindern, da auch hier die Übertäter jene Lichtstrahlen sind, welche die Linse am Rand passieren. Vor allem lichtstarke Objektive sind von den beiden Formen der Aberration betroffen. Spiegelobjektive zeigen diese Fehler nicht.

Die chromatische Aberration lässt sich durch Achromaten bzw. Apochromaten korrigieren. Achromaten sind verkitteten Gruppen aus zwei Linsen, deren chromatische Aberration sich gegenseitig aufhebt. Besteht eine Gruppe aus drei Linsen, je eine für rot, grün und blau, so nennt man sie Apochromaten.

Manche Hersteller verwenden bei ihren Objektiven die Bezeichnung 'APO' um darauf hinzuweisen, dass sie sich um die Korrektur der chromatischen Aberration bemüht haben. Allerdings ist diese Bezeichnung nicht geschützt und so bleibt es jedem Hersteller überlassen, was wirklich hinter dem Kürzel 'APO' steckt. (Allgemeines Panorama Objektiv oder Apochromatisch?)

Weiter geht es mit dem Koma, auch Asymmetriefehler genannt.

Koma (Asymetriefehler)

- Details

- Geschrieben von Thomas

- Kategorie: Kapitel Fünf

- Zugriffe: 6621

Koma (auch Asymmetriefehler)

In der Bildmitte selbst ist von diesem Fehler nichts zu bemerken da er durch Abblenden reduziert werden kann. Dieser Fehler fällt besonders bei Astroaufnahmen auf, wenn einfache Objektive weit geöffnet verwendet werden.

Astigmatismus

- Details

- Geschrieben von Thomas

- Kategorie: Kapitel Fünf

- Zugriffe: 6933

Astigmatismus (Punktlosigkeit)

Auch hier sind schräg einfallende Lichtstrahlen die Übeltäter (siehe Koma). Da sie schräg in die Linse eindringen ist ihr Querschnitt nicht mehr rund sondern eliptisch.Deshalb ergeben sich hier verschiedene Brennpunkte, was einen Schärfeabfall zu den Bildrändern hin bewirkt. Ein Abblenden des Objektivs kann diesen Fehler reduzieren.

Die im Folgenden genannten Abbildungsmängel der Optik kannst Du in zwei Kategorien einteilen

• auffällige

• unauffällige Fehler

Auffällige Mängel können in geeigneten Situationen aus technischer Sicht ein Bild zerstören, wenn der Fehler deutlich genug ausgeprägt ist. Damit musst Du halt leben oder aufgeben!

Ein solcher auffälliger Fehler sind Reflexe.

Reflexe

- Details

- Geschrieben von Thomas

- Kategorie: Kapitel Fünf

- Zugriffe: 6938

Reflexe

können ein Bild stark stören, Streulicht durch starke Reduzierung der Kontraste kann es unscharf machen. Ist die Sonne mit im Bild ist, etwa bei Gegenlichtaufnahmen oder Aufnahmen von Objekten im Schnee, kann die Vergütung der Objektive und die Streulichtreduzierung zum begrenzenden Faktor werden. Eine wichtige Eigenschaft von Objektiven ist deshalb die Qualität der Vergütung, ganz abgesehen von Verschmutzungen auf der Frontlinse, wie z.B. Fingerabdrücken.

können ein Bild stark stören, Streulicht durch starke Reduzierung der Kontraste kann es unscharf machen. Ist die Sonne mit im Bild ist, etwa bei Gegenlichtaufnahmen oder Aufnahmen von Objekten im Schnee, kann die Vergütung der Objektive und die Streulichtreduzierung zum begrenzenden Faktor werden. Eine wichtige Eigenschaft von Objektiven ist deshalb die Qualität der Vergütung, ganz abgesehen von Verschmutzungen auf der Frontlinse, wie z.B. Fingerabdrücken.Große Frontlinsen lichtstarker Objektive, sowie Objektive mit vielen Linsen (z.B. Zoomobjektive) sind aufgrund ihrer Bauform anfälliger für Streulicht und Reflexe, grundsätzlich empfindlich sind Weitwinkelobjektive mit großem Bildwinkel (große Frontlinse).

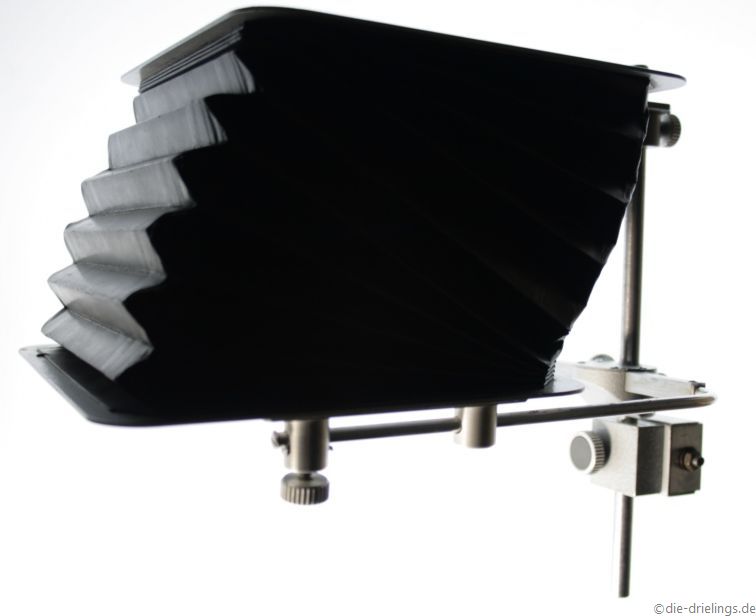

Gegenmaßnahmen, wenn Streulicht oder Reflexe auftreten

Spiegelreflexkameras oder Digitalkameras mit rückseitigem Bildschirm haben gegenüber (analogen) Sucherkameras den Vorteil, dass Du bei ihnen auf dem Monitor Reflexe und Streulicht erkennen kannst. Schon eine kleine Standortänderung, eine Veränderung des Winkels zur Lichtquelle, kann die Situation verbessern. Auch die Streulichtblende ist ein wirksames Mittel um Reflexe zu verhindern oder wenigstens zu reduzieren.

Spiegelreflexkameras oder Digitalkameras mit rückseitigem Bildschirm haben gegenüber (analogen) Sucherkameras den Vorteil, dass Du bei ihnen auf dem Monitor Reflexe und Streulicht erkennen kannst. Schon eine kleine Standortänderung, eine Veränderung des Winkels zur Lichtquelle, kann die Situation verbessern. Auch die Streulichtblende ist ein wirksames Mittel um Reflexe zu verhindern oder wenigstens zu reduzieren. Aber nicht nur Objektive haben eine Vergütung, auch Filter. Ein billiger Filter hat auf einem hochwertigen Objektiv nichts verloren.

Natürlich kann auch eine geeignete Gegenlicht-/ Streulichtblende oder aber, je nach Kamera, ein Kompendium (siehe Foto) helfen.

Die nächste Gruppe an Abbildungsfehlern ist die Vignettierung.

Vignettierung

- Details

- Geschrieben von Thomas

- Kategorie: Kapitel Fünf

- Zugriffe: 7304

Vignettierung bezeichnet einen Lichtabfall zu den Bildrändern und wird ab ungefähr 1 LW Unterschied im Bild sichtbar. Sie fällt dabei besonders in gleichmäßig ausgeleuchteten Flächen auf, z.B. in blauem strukturlosem Himmel. Sie wird verstärkt durch Unterbelichtung.

Bei den meisten Available-Light Aufnahmen stellt sie allerdings kein Problem dar. Die Unterschiede in der Helligkeit sind hier meist ohnehin sehr groß, das Bild ist von Natur aus nicht gleichmäßig ausgeleuchtet. Nur in ganz krassen Fällen sind hier noch stärkere Abweichungen überhaupt erkennbar.

Aufgrund ihrer Ursachen werden zwei Arten der Vignettierung unterschieden:

Natürliche Vignettierung

Du erkennst dieses, wenn Du schräg auf die Blende eines Objektivs schaust, sie erscheint auf diese Weise oval und verkleinert. Sie lässt weniger Licht durch, die Ecken des Bildes werden weniger belichtet. Daher lässt sich natürliche Vignettierung auch durch Abblenden nicht beseitigen. Abhilfe stellen speziell an das Objektiv angepasste Centerfilter (Radial-Graufilter) dar, die das Bildzentrum auf die gleiche Helligkeit abdunkeln wie die Bildränder, allerdings bei allgemeinem Verlust an Helligkeit. Diese Filter sind allerdings für Kleinbildobjektive nicht sehr verbreitet und allgemein sehr teuer. Für Großformatobjektive kosten sie teilweise soviel wie ein günstiges Objektiv, d.h. so um die 500-1000€ (allerdings neu).

Mittlerweile habe ich auch "echte" Fotos mit natürlicher Vignettierung, von denen ich eines hier darstellen will.

Mittlerweile habe ich auch "echte" Fotos mit natürlicher Vignettierung, von denen ich eines hier darstellen will.Künstliche Vignettierung

Eine weitere häufige Ursache können falsch dimensionierte Streulichtblenden oder Filter sein, welche in das Bild ragen. Eigentlich sollte man meinen, dass diese im Sucher erkennbar sind. Das ist in der Tat auch so, allerdings erfordert dies erhöhte Aufmerksamkeit.

Deshalb solltest Du jede vernünftig erscheinende Filter- und Streulichtblendenkombination vor dem „scharfen Einsatz“ ausprobieren und genau auf Vignettierung überprüfen.

Im Vorteil sind hier definitiv Besitzer einer Kamera mit 100% Sucher (also ich nicht, Canon spendiert so etwas ja nur den High-End Geräten), hier ist Vignettierung leichter erkennbar. Auf dem fertigen Foto, welches nie das volle Filmformat ausnutzt, sind die Ecken dann sogar noch etwas verringert. Da durch Abblenden ein kleinerer Teil des Strahlengangs des Objektivs benutzt wird, kann geringe künstliche Vignettierung unter Umständen sogar auf diese Weise entfernt werden.

Falls dies jedoch nicht gelingt, wird der Unterschied zwischen den hellen Bildteilen und den abgedunkelten Bildrändern durch die vergrößerte Schärfentiefe noch herausgestellt und ist noch störender im Bild zu erkennen.

Betroffen sind in erster Linie Weitwinkelobjektive (natürliche Vignettierung), sowie besonders lichtstarke Objektive (künstliche Vignettierung) und in ganz besonderem Maße lichtstarke Weitwinkelobjektive.

Ein weiterer, und auch der letzte, auffällige Abbildungsfehler ist die geometrische Verzeichnung.

Geometrische Verzeichnung

- Details

- Geschrieben von Thomas

- Kategorie: Kapitel Fünf

- Zugriffe: 7335

Distorsion oder auch Geometrische Verzeichnungen sind Fehler, die Rechtecke tonnen- oder kissenförmig verzerrt im Bild erscheinen lassen. Ursache für diesen Fehler ist meist unsymmetrischen Aufbau des Objektivs vor und hinter der Blende, Du kannst Geometrische Verzeichnung durch Abblenden nicht beseitigen!

Geometrische Verzeichnung finden sich vor allem bei Zoom- und Weitwinkelobjektiven, und ganz besonders bei den lichtstarken Vertretern, da bei ihnen die Korrektur der Verzeichnung keinen Vorrang hat.

Tele-Festbrennweiten sind im allgemeinen fotografischen Einsatz mehrheitlich frei von geometrischer Verzeichnung. Üblicherweise zeigen Festbrennweiten geringere geometrische Verzeichnung als Zoomobjektive; diese haben meist bei kürzeren Brennweiten tonnenförmige, bei längeren Brennweiten kissenförmige Verzeichnung. Irgendwo im mittleren Brennweitenbereich sind sie meist frei von Verzeichnungen.

Geometrische Verzeichnung kannst Du vor dem Kauf von Gerät systematisch prüfen. Dieses kannst Du zum Beispiel durch Aufnahme eines geeigneten Motivs tun. Dieses solltest Du dann an einem Monitor genau nach geometrischen Verzeichnungen absuchen.

Durch den Blick in den Kamerasucher kannst Du die Verzeichnung nur sehr schlecht beurteilen, da die Sucheroptik ebenfalls diesen Mangel haben kann. Der Bildschirm der Kamera ist im allgemeinen viel zu klein um etwas erkennen zu können, ein eingeblendetes Gitternetz kann dieses etwas erleichtern. Du solltest aber trotzdem Deine Testaufnahmen an einem richtigen Bildschrim betrachten.

Im nächsten Beitrag geht es um das Blooming, ein Phänomen, welches nicht durch die Optik, sondern durch digitale Sensoren erzeugt wird.

Blooming

- Details

- Geschrieben von Thomas

- Kategorie: Kapitel Fünf

- Zugriffe: 6936

Blooming  bezeichnet den plötzliche Kontrastverlust durch Überzeichnung in hellen Bildteilen. Befinden sich in Deinem Motiv sehr hohe Helligkeitswerte, sind vor allem ältere CCD–Sensoren ab einem bestimmten Punkt nicht mehr in der Lage, die umgebenden Bereiche fein abgestuft wiederzugeben.

bezeichnet den plötzliche Kontrastverlust durch Überzeichnung in hellen Bildteilen. Befinden sich in Deinem Motiv sehr hohe Helligkeitswerte, sind vor allem ältere CCD–Sensoren ab einem bestimmten Punkt nicht mehr in der Lage, die umgebenden Bereiche fein abgestuft wiederzugeben.

Die "überschüssigen" elektrischen Ladungen der überbelichteten Sensorzellen beginnen auf benachbarte Zellen überzuschwappen und füllen deren Ladung auf. Dabei erzeugen sie eine nahezu einfarbig weiße Fläche im Bild.

Blooming ist daher ein typischer digitaler Bildfehler, auch wenn es dem Ausbrennen der Lichter in der analogen Fotografie natürlich sehr ähnlich ist.

Blooming zeigt sich meist als mehr oder weniger langer Streifen, welches von der Lichtquelle ausgehend parallel zur kurzen Bildseite verläuft. Dieses liegt daran, dass besonders jene Sensorzellen für Blooming empfindlich sind, welche zum zeilenweise Auslesen der Bilddaten miteinander verbunden sind.

Anmerkung:

Allerdings ist dieses nicht die einzige Definition die man für Blooming finden kann! Manchmal wird auch ein nach alle Seiten ausgedehntes Verlaufen als blooming bezeichnet, welches wiederum an anderer Stelle als Smear bezeichnet wird, siehe Bildbeispiel oben.

Der Blooming Effekt kann durch bauliche Maßnahmen im Sensor, den sogenannte Anti-Blooming Gates verringert oder auch, bis zu einem gewissen Punkt verhindert werden. Dazu werden anstelle der „normalen“ Isolation, welche die einzelnen Sensorzellen elektrisch voneinander trennt, zusätzliche „Gräben“ zwischen den Sensorpixeln eingebaut. Deren Aufgabe ist es, die überschwappenden elektrischen Ladungen aufzufangen und abzuleiten, um auf diese Weise das Blooming zu verhindern oder wenigstens zu reduzieren.

Der große Nachteil dieser Maßnahme ist jedoch die Verminderung der nutzbare Pixelfläche auf etwa 70%. Das heißt, die Bereiche des Sensors auf denen keine Bildinformationen gewonnen werden können, vergrößern sich, die Auflösung und Bildschärfe des Sensors sinken.

Für unsere „normale“ Fotografie ist dieses sicherlich ärgerlich, aber nicht wirklich ein Problem.

Gänzlich anders ist dieses jedoch in Bereichen, welche mit extrem wenig Licht bei gleichzeitig hohem Helligkeitskontrast arbeiten müssen, z.B. in der Astrofotografie. In diesem Bereich kann man es sich nicht leisten, dass derart große Anteile der Sensorfläche blind sind, oder aber Sensoren ein Blooming zeigen.

Für derartig spezielle Aufgaben setzt man meist Sensoren ohne Anti-Blooming Gates ein und verwendet andere Techniken um das Blooming zu verhindern.

Hierzu löst man mehrere kürzere Belichtungen schnell hintereinander aus, welche alle unterhalb der Blooming-Schwelle liegen. Die dabei gewonnenen Einzelaufnahmen werden dann mittels Bildbearbeitungsprogrammen übereinander legt, um am Schluss ein auswertbares Bild zu erhalten.

Der nächste, typisch digitale Bildfehler sind die Hotpixel.

Hotpixel

- Details

- Geschrieben von Thomas

- Kategorie: Kapitel Fünf

- Zugriffe: 6571

Hotpixel sind, neben dem normalen Hintergrundrauschen, besonders bei Nachtaufnahmen, eine weitere Quelle für Bildfehler, sie zeigen sich als helle Punkte im Bild.

Sie entstehen, weil immer wieder einzelne Zellen des Sensors nicht gleichmäßig auf einfallendes Licht reagieren. Da dieses (Fehl)-Verhalten wärmeabhängig ist, heißen diese Punkte Hotpixel.

Das Phänomen, welches dahinter steckt nennt sich Dunkelstrom. Dieser ist proportional zur Wärme des Sensors und verdoppelt sich jeweils mit einer Erwärmung von 7°C.

Jedoch sind nicht alle Pixel in gleichem Maße von diesem Dunkelstrom betroffen, seine Stärke hängt vom Reinheitsgrad des verwendeten Siliziums ebenso wie von Fertigungstoleranzen bei der Herstellung ab. Das bedeutet, dass jeder Sensor und somit jede Digitalkamera Hotpixel zeigt. Da es sich um ganz bestimmte Pixel handelt, treten sie bei einem einzelnen Sensor immer an derselben Stelle auf, sind also Kameraabhängig und damit sozusagen ein Erkennungsmerkmal jeder Kamera. In der digitalen Bildforensik werden sie verwendet, um herauszufinden ob eine bestimmtes Bild mit einer bestimmten Kamera aufgenommen wurde.

Wie stark ein Sensor Hotpixel zeigt, hängt jedoch auch stark von der Belichtungszeit und der eingestellten ISO-Zahl ab. Je länger Du belichtest, desto mehr Hotpixel zeigen sich.

Theoretisch könnte das so weit gehen, dass irgendwann Dein gesamtes Bild weiß wird.

Es gibt unterschiedliche Methoden Hotpixel zu reduzieren. Manche Kamerahersteller begrenzen die Belichtungszeit auf wenige Sekunden, andere verwenden bereits kameraseitig eine Hotpixel Korrektur. Dabei werden die, durch den hohen Kontrast zu den sie umgebenden Pixeln, erkennbaren HotPixel ermittelt und bereits in der Kamera korrigert.

Spezielle Kameras für Langzeitaufnahmen verwenden gekühlte Bildsensoren.

Am einfachsten ist es, wenn Du Aufnahmen mit kalter Kamera machst. Eine kalte Kamera erreichst Du dadurch, dass Du sie immer ausschaltest, wenn gerade nichts zu fotografieren ist, in den Optionen den Bildschirm abschaltest und das CCD so einstellst, dass es sich erst beim Fotografieren einschaltet und nicht die ganze Zeit aktiviert ist. Außerdem solltest Du die Blende weit aufmachen, so dass Du Belichtungszeit und Empfindlichkeit auf kleine Werte einstellen kannst. Ob Du nun mit kurzer Belichtungszeit oder mit einer geringen Empfindlichkeit fotografierst, ist eher egal.

Natürlich kann man Hotpixel auch nachträglich mit entsprechenden Programmen entfernen. Der Suchbegriff „Hotpixel entfernen“ in einer Internet-Suchmaschine Deiner Wahl zeigt die üblichen Verdächtigen.

Eine andere Methode ist es, nach einer Langzeit-Aufnahme, eine weitere Aufnahme mit geschlossenen Objektivdeckel zu machen. Die in dieser zweiten Aufnahme leicht erkennbaren Hotpixel, werden dann aus der Langzeitaufnahme gezielt heraus gerechnet.

Hotpixel darfst Du nicht mit Stuckpixeln verwechseln. Letztere sind kaputte Pixel und bei jedem Bildschirm vorhanden, also auch an dem Deiner Kamera. Stuckpixel siehst Du jedoch hinterher nicht im Bild, da sie ein Fehler des Monitors sind.

Man sieht sie immer recht schön beim Einschalten des PC beim schwarzen Windows Startbild.

Weiter geht es mit dem oft und heißt diskutieren Thema Bildrauschen.

Bildrauschen

- Details

- Geschrieben von Thomas

- Kategorie: Kapitel Fünf

- Zugriffe: 3834

Bildrauschen, woher kommt es? Die analogen Signale aller drei Sensorentypen werden verstärkt, bevor sie zum A/D-Wandler geführt werden. Den Verstärkungsfaktor kannst Du durch die Wahl der ISO-Empfindlichkeit beeinflussen; je höher die Empfindlichkeit, desto mehr werden die Signale verstärkt.

Auch die Baugröße der Sensoren ist ein weiterer wichtiger Aspekt in Bezug auf das Rauschverhalten. Je größer die Sensorfläche eines Chip bei einer bestimmten Auflösung ist, desto größer sind auch die einzelnen Sensorpixel. Flächenmäßig größere Pixel können mehr Licht aufnehmen, die Lichtempfindlichkeit steigt, ebenso der Dynamikumfang. Ein Umstand der irgendwie an den guten alten Film erinnert!

Ist dagegen die Fläche eines Pixel sehr klein, muss ihr Signal elektronisch verstärkt werden.

Wie unter Sensoren beschrieben ist beim CMOS-Sensor die lichtempfindliche Fläche eines Sensorpixels kleiner als beim CCD, da hier Speicherbausteine und der A/D-Wandler eingebaut sind. Das Nutzsignal ist bei diesen Sensoren deshalb kleiner, sie müssen verstärkt werden.

In den Signalen des Sensoren sind jedoch immer Störungen enthalten, diese werden ebenfalls verstärkt und zwar mit dem gleichen Faktor wie das eigentliche Nutzsignal. Hast Du ein starkes Signal mit schwachen Störungen und verstärkst beide, so bleibt das Nutzsignal deutlich stärker und überdeckt die schwache Störung. Verstärkst Du aber das schwache Signal zusammen mit schwachen Störungen, so werden im Vergleich zum Nutzsignal die Störungen ebenfalls stärker und gelangen in Bereiche, in denen sie wahrnehmbar werden.

Der Grund dafür ist recht einfach und an einem Beispiel leicht erklärt.

Du hörst eine CD, diese hat laute und leise Titel. Wenn Du einen lauten Titels abspielst, übertönt die laute Musik (Nutzsignal), die immer vorhandenen Störgeräusche (Störsignal), da sie wesentlich lauter ist. Ob Du diesen Titels laut oder leise hörst, ist egal, der Unterschied zwischen Nutz- und Störsignal ist so weit auseinander, dass die Musik die vorhandenen Störungen immer übertönt.

Dann kommt ein leiser Titel! Hier ist der Anteil und die Stärke der vorhandenen Störsignale gleich groß wie beim vorherigen lauten Titel. Allerdings ist das Nutzsignal kleiner, der Unterschied in der Signalstärke ist bei weitem nicht so groß wie vorher.

Wenn Du den leisen Titel bei der gleichen Lautstärke wie den lauten Titel hören willst, musst Du, weil sein Nutzsignal niedriger ist, Deine Musikanlage lauter aufdrehen. Dadurch wird zwar die Musik lauter, gleichzeitig aber auch das Störsignal stärker verstärkt als vorher.

Das stark verstärkte, schwache Signal der Musik, kann die ebenfalls stark verstärkte, schwache Störung nicht übertönen, die Störungen sind deutlich hörbar.

Vergleichbares haben wir bei den Sensoren. Die Information, die ein flächenmäßig größerer Sensorpunkt sammeln kann, ist im Vergleich zu den Störungen wesentlich größer, als das Nutzsignal, welches ein flächenmäßig kleinerer Sensor sammeln kann. Dessen Signal muss, um nutzbar zu sein, mehr verstärkt werden, welches gleichzeitig auch die Störungen verstärkt.

Während Du mit einer DSLR aufgrund Ihrer meist recht „großen“ Sensoren problemlos mit ISO 800 und noch darüber fotografieren kann, ist bei Kompaktkameras bei ISO 400 oft schon kein brauchbares Foto mehr zu machen.

Aktuelle Sensoren haben Größen zwischen 5,7mm*4,2mm und 36*24mm, letztere werden oft als Vollformat-Sensoren bezeichnet, da ihre Größe der eines KB-Filmes entspricht. Man findet diese bisher nur in den teuren Spiegelreflexkameras. Viele DSLRs verwenden Chips im APS-C Format (23,7mm*15,6mm; EOS 400D 22.2 x 14.8mm CMOS). Olympus DSLRs verwenden Sensoren mit dem eigenen Four-Thirds-Standard (18mm*13,5mm); Kompaktkameras verwenden wesentlich kleinere Sensoren, siehe dazu auch Sensorformate.

Auch wenn die Hersteller die Rauschunterdrückung mittlerweile recht gut im Griff haben, ist meist eine Kamera mit größerem Sensor und etwas kleinerer Auflösung einem Megapixel Monster mit Mini-Chip vorzuziehen.

Aus diesem Grund fällt bei digitalen Bildern das Rauschen hauptsächlich bei Aufnahmen mit hohen Empfindlichkeiten auf (so wie die Körnung bei schnellen Filmen bei starker Vergrößerung!)

Rauschen kann aber auch entstehen, wenn aus einem vorher guten 3Mpixel-, plötzlich eine 5Mpixel-Chip gemacht wird, indem einfach die Sensoren enger aneinander gebaut werden. In einem solchen Fall neigen die Sensoren dazu, ihre Ladungen auch an (unbeteiligte) benachbarte Sensoren abzugeben, das Rauschen wird stärker.

Wie sieht Bildrauschen aus?

Ich habe hier einfach mal ein paar Dinge auf dem Schreibtisch fotografiert. Dabei habe ich jeweils die ASA-Empfindlichkeit erhöht. Links siehst Du jeweils das Bild in der Übersicht, rechts der jeweils gleiche Ausschnitt davon.

Einstellung: ASA 100

Einstellung: ASA 200

Einstellung ASA 400

Einstellung ASA 800

Einstellung ASA 1600 (alle Bilder aufgenommen mit Panasonic FZ50)

Bei neueren, besseren, teureren Kameras wird das ggf. nicht so stark auffallen, es geht hier jedoch nicht um einen Kameravergleich, sondern um das Prinzip.

Wie Du an den dargestellten Bildbeispielen unschwer erkennen wirst, kannst Du Bildrauschen recht wirkungsvoll verhindern, indem Du bei unbewegten Motiven eine niedrigere Empfindlichkeit wählst und entsprechend länger belichtest (Stativ).

Natürlich kannst Du auch nachträglich versuchen Rauschen zu entfernen; viele Kameras haben einen Rauschfilter oder Du kannst versuchen, dass Bildrauschen am Rechner zu vermindern.

Es stellst sich für mich allerdings die Frage, ob sich im Vergleich zu der recht einfachen Maßnahme „Benutze ein Stativ und niedrige Empfindlichkeit“ derartige, doch recht zeitintensive Nachbearbeitungen überhaupt lohnen.

Zum Kapitel Bildfehler fehlt jetzt noch der Beitrag zum Thema "Bokeh", bevor es von dort dann zum Kapitel Sechs weitergeht, welches sich mit dem fotografischen Zubehör beschäftigen soll.

Bokeh

- Details

- Geschrieben von Thomas

- Kategorie: Kapitel Fünf

- Zugriffe: 43432

Bokeh [bo-keh] von japanisch boke = unscharf, verschwommen

Der Begriff Bokeh scheint aus Japan zu kommen und wird, mittlerweile nicht nur dort, in Fachzeitschriften bei Objektivtests zusammen mit anderen Größen beschrieben. Er ist kein numerischer Wert, seine Angabe erfolgt im Bereich von gutem bis schlechtem Bokeh.

Der Begriff Bokeh scheint aus Japan zu kommen und wird, mittlerweile nicht nur dort, in Fachzeitschriften bei Objektivtests zusammen mit anderen Größen beschrieben. Er ist kein numerischer Wert, seine Angabe erfolgt im Bereich von gutem bis schlechtem Bokeh.

Wie wir bereits festgestellt haben, können Motive nur in einer Ebene wirklich scharf abgebildet werden. Punkte außerhalb dieser Schärfeebene werden nicht als Punkte, sondern als sogenannte Zerstreuungskreise abgebildet, die umso größer ausfallen, je weiter sie von der eigentlichen Schärfeebene entfernt sind.

Der Begriff Bokeh bezieht sich auf die Eigenschaften dieser Zerstreuungskreise und beschreibt das Abbildungsverhalten eines Objektivs in unscharfen Bildbereichen.

Bokeh wird durch zwei Faktoren bestimmt:

- der Blendenform

- der Art und Weise der optischen Korrektur des Objektivs.

Blendenform

Jeder Punkt welcher außerhalb der Schärfeebene liegt, wird als Zerstreuungskreis vergrößert dargestellt und nimmt dabei die Form der Blende an.

Formt diese ein Achteck, so werden die Zerstreuungskreise ebenfalls achteckig dargestellt. Diese Zerstreuungskreise werden besonders sichtbar in hellen Punkten auf dunklem Grund, z.B. als Spitzlichter auf einer Wasseroberfläche oder den Lichtern einer Stadt bei Nacht.

Gerade für Nachtaufnahmen, available Light oder Innenaufnahmen bei denen nicht geblitzt werden darf (z.B- im Museum, oder im Zoo) sind lichtstarke Objektive das Werkzeug der Wahl, ebenso eignen sie sich besonders für Aufnahmen mit selektiver Schärfe. Sie sollten dann jedoch über eine Blende mit vielen Lamellen verfügen, welche idealerweise dann auch noch so eingebaut sind, dass sie einen Kreis bilden. Auch wenn eine runde, oder möglichst "zackenfreie" Bauform der Blende noch kein Garant für gutes Bokeh ist! Das negative Extrem in Bezug auf die Abbildung von Zerstreuungskreisen stellen Spiegellinsenobjektive dar, welche aufgrund ihrer ringförmigen Öffnung ziemlich auffällig im Bild erscheinen.

Der Korrekturzustand einer Optik

Um eine scharfe Abbildung zu erreichen, sollten alle Lichtstrahlen die von einem fokussierten winzigen Punkt im Motiv ausgehen und von dort ins Objektiv fallen, wieder zu einem winzigen Punkt auf dem Film gebündelt werden.

Die Wirklichkeit ist von diesem "Idealzustand" meist nicht weit entfernt: Ein Grossteil der Lichtstrahlen fällt tatsächlich ungefähr dorthin, wo sie hin sollen, die Restlichen landen meist nur wenig daneben. Aus dem winzigen Punkt ist ein immer noch sehr kleiner Punkt geworden.

Die leicht "verirrten" Strahlen bilden eine Art Lichthof, von welchem sich der kleine Punkt nicht sehr deutlich abhebt. Ein Objektiv mit einer solchen Abbildungsqualität hat zwar eine hohe Auflösung, aber einen eher schlechten Kontrast.

Mit dem gleichen technischen Aufwand lässt sich jedoch auch ein anderer optischer Korrekturzustand des Objektivs erreichen. Ein Großteil der im Objektiv einfallenden Lichtstrahlen bildet hierbei zwar einen etwas größeren Punkt, die "verirrten" Strahlen werden allerdings in geringerem Abstand abgebildet. Die Auflösung des Objektivs ist in diesem Falle zwar etwas geringer (größerer Punkt), dafür nimmt der Kontrast des Objektivs zu, weil der Lichthof kleiner ist und der Punkt sich deshalb deutlicher vom Umfeld abhebt. Du hast in diesem Fall ein Objektiv mit geringerer Auflösung aber höherem Kontrast. Stelle Dir diesen Fall als einen breit und unscharf auslaufenden, aber spitzen Lichthaufen vor, der so zusammengeschoben wurde, dass er einen klar begrenzten Haufen ohne besonders ausgeprägte Spitze bildet.

Aus diesem Grunde ist die hochgelobte Auflösung eines Objektivs nämlich nicht alles was zählt. In diesem Bild sind solche Zerstreuungskreise sichtbar.

Bokeh ist deshalb eine Abbildungseigenschaft welche durch die Korrektur des verwendeten Objektivs erzeugt wird.

Der erste Punkt stellt den Zerstreuungskreis eines theoretischen Objektivs dar. Er ist frei von sphärischer Aberration und ohne kontrastoptimierende Eigenschaften in der Schärfeebene (tiefere Auflösung gegen höheren Kontrast). Der Zerstreuungskreis weist eine gleichmässige Helligkeitsverteilung auf und ist hart gegen das Umfeld abgegrenzt.

Der erste Punkt stellt den Zerstreuungskreis eines theoretischen Objektivs dar. Er ist frei von sphärischer Aberration und ohne kontrastoptimierende Eigenschaften in der Schärfeebene (tiefere Auflösung gegen höheren Kontrast). Der Zerstreuungskreis weist eine gleichmässige Helligkeitsverteilung auf und ist hart gegen das Umfeld abgegrenzt. Im Bild rechts ist eine andere Variante des Zerstreuungskreise dargestellt. Dieser Typ tritt im Bildhintergrund auf, wenn in der Schärfeebene der Kontrast auf Kosten der Auflösung erhöht wurde - so wie dies bei fast allen modernen Fotoobjektiven der Fall ist. Man spricht bei dieser Korrektur von überkorrigierter sphärischer Aberration.

Im Bild rechts ist eine andere Variante des Zerstreuungskreise dargestellt. Dieser Typ tritt im Bildhintergrund auf, wenn in der Schärfeebene der Kontrast auf Kosten der Auflösung erhöht wurde - so wie dies bei fast allen modernen Fotoobjektiven der Fall ist. Man spricht bei dieser Korrektur von überkorrigierter sphärischer Aberration.Man erkennt diese Form daran das er hart gegen das Umfeld abgegrenzt ist und im Randbereich außerdem heller erscheint. Dies führt im Hintergrund zu schlechtem Bokeh. Helle Objekte und Kanten im ansonsten unscharfen Hintergrund werden durch diese Form der Objektivkorrektur meist stark betont und verschwinden nicht unauffällig in Unschärfe. Das geht so weit, dass Linien im Hintergrund aufgrund der hellen Kante als feine Doppellinie erscheinen und den Hintergrund und damit das Ganze Bild unruhig erscheinen lassen.

Möglich ist allerdings auch die gegenteilige Korrektur, die als - unterkorrigierte sphärische Aberration bezeichnet wird. Das Aussehen von unscharfem Hinter- und Vordergrund ist gegenüber der überkorrigierten sphärischen Aberration vertauscht. Bildelemente des Hintergrundes werden in einer sehr schönen und ruhigen Unschärfe verschwinden - der Vordergrund wird im Gegensatz dazu eher unruhig und hart erscheinen.

Möglich ist allerdings auch die gegenteilige Korrektur, die als - unterkorrigierte sphärische Aberration bezeichnet wird. Das Aussehen von unscharfem Hinter- und Vordergrund ist gegenüber der überkorrigierten sphärischen Aberration vertauscht. Bildelemente des Hintergrundes werden in einer sehr schönen und ruhigen Unschärfe verschwinden - der Vordergrund wird im Gegensatz dazu eher unruhig und hart erscheinen.Bokeh ist daher eine, durch die Korrektur des Objektivs gegebene Abbildungseigenschaft.

Auch wenn der Begriff Bokeh noch lange nicht ausdiskutiert ist und vom persönlichen Empfinden des Betrachters abhängt, eine kurze Eingruppierung.

Exzellentes Bokeh

Von exzellentem Bokeh wird im allgemeinen gesprochen, wenn die Unschärfe weich und gleichmäßig verläuft. An Rändern im Unschärfebereich zeigen sich keine Farbsäume, Linien werden nicht verdoppelt, Spitzlichter erscheinen rund und ohne scharf abgegrenzte Ränder.

Gutes Bokeh

Im Falle eines guten Bokeh verläuft die Unschärfe weich und gleichmäßig, in den Bildecken sind im Unschärfebereich vereinzelt kleine Farbsäume. Linien sind jedoch nicht verdoppelt, Spitzlichter unter Umständen leicht polygonal, aber noch ohne allzu scharf abgegrenzte Ränder.

Schlechtes Bokeh

zeigt sich durch einen unruhigen Unschärfebereich, der dadurch unangenehm auffällig wird. Kanten im Hintergrund erscheinen verdoppelt und sind so deutlich, dass sie den Bildeindruck deutlich zu stören vermögen. Kontrastreiche Bereiche im Hintergrund zeigen oft ins violette gehende Farbsäume. Zu den Bildecken hin erscheinen verstärkte Farbverschiebungen. Spitzlichter bilden polygonale Form bei deutlich abgegrenzten Kanten, von ihren Ecken scheinen gelegentlich Strahlen auszugehen.

Bokeh gewinnt vor allem dann an Bedeutung, wenn große Bildanteile mit nicht sehr hellem Grund unscharf gehalten werden sollen . Gerade hier können bei schlechtem Bokeh Spitzlichter oder Kanten überdeutlich negativ hervortreten.

Gutes Bokeh ist deshalb besonders wichtig für:

-

-

Portrait-,

-

Available-Light-Fotografie,

-

Nachtaufnahmen und zur

-

Gestaltung mit selektiver Schärfe.

-

Im Gegensatz dazu ist Bokeh von geringerer Bedeutung bei Aufnahmen

-

-

von Objekten ohne Tiefenausdehnung, wie Repro oder Vergrößerungen,

-

mit hyperfokaler Distanzeinstellung, wenn sich die Schärfentiefe bis Unendlich ausdehnt (Weitwinkelobjektive),

-

mit hellem Hintergrund, weil sich Spitzlichter dort schlecht abzeichnen,

-

mit kleineren Blenden oder lichtschwächeren Objektiven, da hier die Zerstreuungskreise kleiner werden.

-

Gutes Bokeh stellt nie ein Problem dar, schlechtes Bokeh ist jedoch eines, wenn Du bemerkst, dass Du mit einem Objektiv nicht warm wirst, ohne sagen zu können worin genau Dein Problem besteht. Wenn man Bewertungen zu Objektiven ließt kann man das immer wieder feststellen. Viele, auch vermeintlich gute Objektive, haben offenbar schlechtes Bokeh. Dieses ist zum Teil sicherlich darin begründet, dass immer noch in den meisten Objektivtest die Punkte Auslösung und Kontrast Punkte geben, das nicht meßbare und daher sehr subjektive Bokeh aber nicht.

Welche Objektive haben gutes Bokeh?

Mal ganz abgesehen von so richtig schlechtem Bokeh ist eine solche Beurteilung Geschmacksache und steht immer in Verbindung mit der fotografischen Aufgabe. Als Hilfe dafür hier ein paar allgemeine Hinweise:

-

-

Tendenziell haben Objektive älterer Bauart gutes Bokeh.

-

Normal- und kurze Teleobjektive mit mäßiger Lichtstärke weisen meist ein besseres Bokeh auf. Weitwinkelobjektive nach dem Retrofokusprinzip und auch Zoomobjektive mit großem bis sehr großem Zoombereich haben meist ein vergleichsweise eher schlechteres Bokeh.

-

Retrofokusobjektive sind bei KB-(D)SLR häufig bei Brennweiten unter 40mm anzutreffen.

Eine kurze Erklärung: Die Schnittweite eines Objektivs, d.h. der Punkt auf den das Objektiv die Lichtstrahlen scharf sammelt, (also genau dort wo Dein Film/Sensor liegen sollte), entspricht üblicherweise der Brennweite des Objektives.  Deutlicher, als Du es an einer KB-Kamera erkennen kannst, siehst Du dieses am Auszug einer GF-Kamera. Dieser entspricht, sofern auf Unendlich fokussiert wurde, der Brennweite des verwendeten Objektivs. Das funktioniert so nicht mit Teleobjektiven, wie schon im betreffenden Kapitel angesprochen, ist deren Schnittweite kürzer als die Brennweite.

Deutlicher, als Du es an einer KB-Kamera erkennen kannst, siehst Du dieses am Auszug einer GF-Kamera. Dieser entspricht, sofern auf Unendlich fokussiert wurde, der Brennweite des verwendeten Objektivs. Das funktioniert so nicht mit Teleobjektiven, wie schon im betreffenden Kapitel angesprochen, ist deren Schnittweite kürzer als die Brennweite.

Bei Objektiven kurzer Brennweiten an (D)SLR ist diese Schnittweite jedoch so kurz ist, dass der Spiegel (der ja zur Belichtung aus dem Strahlengang geschwenkt werden muss), nicht mehr zwischen Objektiv und Film passt. Hier „helfen“ Retrofokusobjektive, denn bei ihnen ist die Schnittweite, so weit nach hinten verlängert, das man den Spiegel wieder in die Kamera einbauen kann.

Ein ähnliches Problem haben GF-Kameras mit dem Balgen. Bei kurzen Brennweiten "trägt" ein normaler Falten-Balgen zu dick auf, d.h. man kann die Kamera nicht weit genug zusammenschieben. Abhilfe verschafft ein Weitwinkelbalgen, das ist ein flexibler "Sack" aus lichtdichtem Material, der nicht zusammengepresst werden muss. Falls das nicht reicht, oder der Balgen nicht auswechselbar ist, benötigt man eine versenkte Objektivplatine, die das Objektiv im Prinzip hinter die Standarte bringt.

Woher stammt der Begriff Bokeh?

Vermutlich ist der Begriff bokeh die Verenglischung eines japanischen Begriffes. Auf verschiedenen Seiten im Web findet man folgende Herkunftserklärung (funktioniert nur in Englisch):

Apparently there was an English-born Canadian, who while vacationing in Japan was shown some pictures of the English Royal Family. In the background, quite out of focus, was Prince Phillip. The Canadian pointed to Prince Phillip and said to his Japanese host, "Now, there's a great bloke, eh?"

Damit endet das Kapitel Fünf, das nächste wird sich mit fotografischem "Zubehör" beschäftigen. Der erste Abschnitt behandelt den Belichtungsmesser.

Sehr schöne Bildbeispiele und Texte (allerdings in Englisch) zu diesem Thema finden sich bei Kurt Munger.